Блог:Точка Росы

Блог с постами технической направленности — чтобы похвалиться сделанной работой и поделиться результатами исследований, выполненных в текущей рутине.

Если вы умеете пользоваться агрегаторами RSS/Atom, подписывайтесь!. По любым вопросам можно писать сюда.

Весь контент данного блога распространяется на условиях Creative Commons Attribution-ShareAlike 3.0 License (CC-BY-SA)

ROSS-2014 — видео докладов опубликовано

Пару недель назад прошла конференция ROSS-2014, или более звучно → Russian Open Source Summit-2014. Собственно мы недавно зазывали на нее, и публиковали обзор наших видеозаписей прошлогодней ROSS-2013, ну и сразу после этого занялись сьемкой-монтажом-публикацией докладов этого года («еслинемытокот?»).

По прошедшей конференции уже можно почитать вал отзывов, как от обычных блоггеров, так и от настоящих IT-журналистов → [1],[2], [3], [4], [5], [6], [7], [8], [9], [10], [11], [12] и посмотреть фотки — [13], [14].

Не в силах пока конкурировать этими профессиональными обзорами, заметим пару кратких наблюдений:

- Это не веселая конференция разработчиков-тестировщиков-дизайнеров, с котегами на слайдах и играми на Xbox в кулуарах — тут собрались серьезные, возможно немного скучные дядьки — топменеджеры, чиновники, юристы, эксперты-архитекторы крупных вендоров.

- Но, в отличие от прошлого года, не было совсем уж «свадебных генералов», которых лучше не пускать ни на свадьбу, ни близко к ITшным темам.

- Участники — тоже серьезная публика «в пиджаках», молодежных гиков, в отличие от прошлого года, было совсем мало.

- Темы «Open-Source и бизнес», «Open-Source и государство» — хайп вокруг них был несколько лет назад, в прошлом году, наверно был закономерный минимум, ну а сейчас, в связи с кучей громких политических и ITшных событий, наконец-то пришло осознание глобальных рисков, «черных лебедей», от которых раньше привычно отмахивались. И что надежность софта требует, как необходимого условия открытость кода и стандартов, но что этого совсем недостаточно[1] — нужен национальный бизнес вокруг этого.

- Эти темы плотно обсуждали на специально организованных пяти дискуссиях — да, понятное дело, наверно любой из читающих эти строки, уже имеет свое мнение по теме (от «все плохо» до «мы еще покажем»), но гораздо интересней послушать, что думают инсайдеры процесса, лица принимащие решения на корпоративном или государственном уровне.

- И, хотя многие доклады можно расценить, как «маркетинговые» (что обычно, на IT-конференциях не любят), здесь тема «Что вы сделали на базе open-source, и как вы это продаете» — она наоборот, приветствовалась.

- Да, некоторых конечно очень бы хотелось прокачать в искусстве публичных выступлений и оформлении слайдов, но мы не в программном комитете, а большинство выступающих, скажем так, уже выбрали свой стиль.

Впрочем, мне тут говорили, что 99% всех пользователей социальных сетей не могут осилить видео дольше трех минут… ну вот, вся конференция за две минуты — может это видео[2] передаст стиль и ощущения?

Мы же, своими ограниченными ресурсами, постарались донести все это, так, чтобы было удобно смотреть — для всех этих пяти секций мы записывали и экран, и несколько планов (крупный-общий-зал), и несколько источников звука… и сколотили из этого качественный информационный консерв, дающий эффект присутствия.

Итак, встречайте → ROSS-2014

Как обычно, мы даже несколько взбодрили доклады ускорением темпа (может быть недостаточно?), к каждому докладу подшиты слайды, развернутые в инфографику картинок, т.к. не было изначально аннотаций — к большинству докладов подшиты отзывы-обзоры от профессиональных журналистов, и самое главное — вычислены все докладчики, и за пару кликов их можно найти их профили в социальных сетях, профессиональных или не очень (ну или, на худой конец — email).

Да, мы использовали разрабатываемую нашими сотрудниками open-source технологию монтажа конференций, но, т.к. пришлось одним оператором пасти несколько секций, иногда не имея возможности даже добраться до камер-ноутбуков, размещенных в забитых залах, разумеется, без факапов не обошлось:

- В одном из залов кто-то закрыл нашу программу-скринкастер — пришлось все слайды за день «прибивать руками», и до сих пор, пока не доделан один доклад, где кроме слайдов была еще сложная анимация (ужас-ужас...).

- Мы старались записать максимально качественный звук, и в крупных залах, где обычно лютует эхо, записывали с микрофонного канала на диктофоны — увы, местами там наблюдались адские помехи, возможно надо переключать на звук с камер.

- А в один из небольших залов, где звук записывали «с воздуха», оказалось, что он напрямую прилегает к кухне, и грохот тарелок сопровождал несколько докладов… — это тоже наверно можно починить, можно снять более примитивный звук с фотоаппарата, который был в глубине зала…

- На паре докладов отключилась HD-камера крупных планов (это точно не наша диверсия, ибо случилось именно на наших докладах :()

Да, пока мы выложили, бета-версии видео — они вполне смотримы, хотя в них возможны проблемы — рассинхрон, неидеальный звук, или докладчик что-то сверхважное показывает указкой на экране, а он закрыт скринкастом, ну или что-то еще — все не предусмотреть.

Тут мы хотим использовать принципы Open-Source тестирования свежих версий на опытных пользователях, и как в случае с AgileDays, призываем всех смотреть, комментировать, писать о проблемах в видео и свои замечания по теме — как обычно, можно писать в своих блогах, а сбрасывать только ссылку. Большую часть проблем решить пока возможно — взять звук с другого, менее крутого источника (но, видимо стоит, если с основными источниками проблема), сменить план, подкрутить синхронизацию. Ну, а если видео НИКТО не смотрит, то тут будет опять классический дзен-вопрос «о багах в программе, которой никто не пользуется» — их и не надо фиксить.

Активных комментаторов ждет награда — гаджеты, сувениры, признание. Буду даже конкретней — первому тому, кто за бета-период отсмотрит и откомментирует 80% докладов — лично подарю ноутбук с РОСой в подарок. Ну да, а чтобы не случилось классического «Пастернака не читал, но осуждаю» — паттерн большинства комментаторов околоопенсорсных ресурсов, я настоятельно рекомендую при просмотре собирать голубенькие коды, которые будут случайно появлятся на пару десятков секунд по центру видео (и это будут слова, связанные с опенсорсом), и указывать их в комментариях — это будет некоторым доказательством, что вы просмотрели таки видео.

Удачного просмотра, ждем комментариев!

|

- ↑ История с Heartbleed это вполне показало. Кстати, «наши сердца не кровоточат» — эта уязвимость коснулась только ROSA Fresh, где была исправлена за считанные часы, наш ROSA «Marathon» LTS этот баг не затронул, ну а в сертифицированных версиях, подобный баг вообще невозможен — там и сертифицированная криптография, и жесткие права на межпроцессное взаимодейстсвие, и очистка памяти — вытащить секретные ключи из памяти совершенно невозможно.

- ↑ Музыка там тоже «open-source»

Применение наших инструментов разработчика в апстриме

В процессе разработки операционных систем наши разработчики и мэйнтейнеры используют огромное количество разнообразных вспомогательных инструментов (для сборки пакетов, анализа качества кода, анализа изменений и т. д.). Большинство из них — это свободные давно зарекомендовавшие себя инструменты, доступные почти в любом репозитории, такие как, например, rpmbuild, gcc, rpmlint, check, valgrind, diff и др. Но иногда встречаются задачи, для решения которых инструментов еще не было создано. В таких случаях мы создаем свои собственные решения для наших разработчиков. В случае, если эти инструменты могут быть полезны не только для нас, но и для сообщества, мы публикуем их исходные коды.

Примером одной из нестандартных задач был анализ обратной совместимости API/ABI системных библиотек в нашей операционной системе РОСА. Поскольку количество библиотек в системе достигало нескольких тысяч, то отслеживать вручную изменения во всех было слишком неподъемной задачей. Поэтому мы разработали инструмент ABICC, который может производить анализ совместимости изменений в автоматическом режиме. Исходные коды этого инструмента были открыты и постепенно все больше и больше разработчиков библиотек в апстриме пользуются этим инструментом для контроля совместимости API/ABI интерфейсов. В результате этого, нашим мэйнтейнерам библиотек легче обновлять их в системе.

Примерами библиотек, успешно использующих наши инструменты, являются: Pacemaker, MySQL++, Wireshark, Glibc, Enlightenment, libDAP++, libapt, Barry, PySide, PLplot и др. Также довольно большое число разработчиков библиотек предпочитают пользоваться нашим специальным сервисом Upstream Tracker, где они могут бесплатно добавить любую библиотеку и следить за изменениями в ее API/ABI интерфейсе. Примерами таких библиотек являются ImageMagick, V8 и др.

С нашими наиболее популярными open-source инструментами для разработчиков можно ознакомиться здесь. Среди них представлены следующие инструменты:

- ABICC

- инструмент для анализа совместимости API/ABI системных библиотек.

- PkgDiff

- инструмент для классификации файлов в пакете и визуализации изменений.

- Java ACC

- аналог ABICC для Java библиотек.

- API Sanity Checker

- автоматический генератор автоматических модульных тестов для Си/C++ библиотек.

- ABI Dumper

- извлечение ABI-интерфейса из debug-информации библиотеки.

- Vtable Dumper

- извлечение структур виртуальных таблиц из бинарных файлов библиотек.

Мы призываем использовать наши инструменты в апстриме. Это позволяет улучшить качество и стабильность API/ABI интерфейсов. А нам это облегчает и без того сложную работу наших мэйнтейнеров при последующем обновлении библиотек.

Видеозаписи AgileDays-2014 — я хочу сыграть с тобой в игру…

В конце марта в Москве прошла конференция AgileDays-2014, посвященная методам продвинутой разработки, объединенных ценностями Agile Manifesto. Можно пафосно распинаться про ее глобальность, межгалактичность международность, но вот простые факты — почти тысяча человек, два дня, семь десятков докладов в пяти треках… это действительно было круто.

Темы — как всевозможные вопросы продвинутого менеджмента проектов («Мотивация», «Управление продуктами», «Планирование и оценки», «Организация») — в общем, как делать что нужно, эффективно, без насилия и с песней, даже, если для этого вообще нужно отказаться от всего перечисленного — оценок, мотивации, и менеджмента как класса.

Плюс — всевозможные инженерные практики эффективной разработки — тут и Test-Driven Development и Domain Driven Design, и Pair Programming и CQRS-архитектура приложений, Continuous Integration & Deployment и прочий DevOps во всех видах…

В целом, тут собрались самый разные участники — от корпоративщиков, сытых, но скучающих, до вечноголодных упоротых стартаперов — Agile-подходы рулят везде, даже в таких консервативных областях, как 1C-development (да, был доклад и про это).

И если еще недавно, многие, надув щеки, презрительно цедили «Agile? У вас секта… У вас нет по настоящему больших проектов… Это для мелких лохов, а у нас Enterprise… Это для скучного Enterprise, а у нас Продукт… Это для софта, а у нас ВеликийСистемноинженерныйПроектВека… Это для анархистов, не осиливших мудрости PMBOK, SWEBOK, BABOK, и кому не дадут бабок… », то сейчас видно — новые подходы к разработке просто ВЕЗДЕ, и даже нет смысла спорить и переубеждать консерваторов, ведь, как известно «выживание не обязательно». Просто самые продвинутые разработчики и менеджеры не пойдут в компанию, где «угорают по хардкору … и царит дух старой школы»™, а неповоротливость на все более динамичных рынках может убить даже старожилов — в IT не очень работают традиции стабильности «занимаемся программированиемѣ с 1913 года».

Доклады были реально круты — программный комитет[1], отобрал лучших из лучших, самых опытных специалистов и крутых спикеров — прошло время скучных конференций советского стиля, тут же отзывы в целом таковы:

Очень крутые блиц-доклады на #agiledays, как будто на TEDe сижу. ©

Можно почитать более подробные отчеты: [1], [2], [3], [4], [5], [6], посмотреть фотографии [7] или двухминутное видео [8], но, весь этот жанр, «Wish you were here/Ах, как там было хорошо, жаль, что вас не было», несколько обидный для тех, кто там не был. И даже для тех, кто был, но не смог посетить все интересующие доклады — тут было пять треков, и хотя программа была тематически выровнена, не было конкурирующих докладов на схожую тему в одно и то же время, куча народу жаловались на невозможность разорваться.

Good news, everyone!™

Мы организовали и видеосьемку! Снято все, за исключением нескольких игровых мастер-классов — по нашему опыту, в таких интересно участвовать, но смотрят их мало :(.

Как обычно, самые лучшие стандарты информационного видео — монтаж с точной записью экрана, плюс чередование крупных и дальних планов, видна реакция зала[2], по возможности звук с микрофона докладчика, ускорение скучных докладов до бодрого тема лучших спикеров TED, в общем, все как мы любим.

Да, были и проблемы[3] — в паре залов было темно на сцене при ярком экране… — плохо видно докладчика… иногда не очень хорошо получился звук[4]. Но в любом случае, все вполне смотримо. Более того, в рамках первоапрельской шутки, доклады были выложены в специально изуродованном низком качестве, но к моему ужасу, народ не понял шутки, и начал смотреть, благодарить и распространять…

На самом деле, тут я подумал, что просто опубликовать, было бы скучно, и решил сделать это в Agile/Lean-стиле. А именно — итеративно, со сбором пользовательского фидбека, и геймификацией.

Первый первоапрельский драфт был для совсем нетерпеливых, теперь все[5] доклады опубликованы в бета-версии.

Еще раз — это тут Видео AgileDays-2014.

Оно все вполне смотримо, но там встроена отладочная информация («маркеры времени»), и возможно их еще можно будет отредактировать, вырезав секретное или неудачное, поправить планы и т.п.

А спустя месяц наверно (ну, как пойдет), будет выложена уже окончательная версия.

Так вот, раз ты дочитал до сюда, ты — явно неглупый потенциальный зритель.

И я хочу сыграть с тобой в Игру.

Нет, это не страшная игра на выживание, это Win-Win игра, и я сразу объясню, кому и что тут интересно.

Да, мы хотим, что бы эта конференция стала не только местом тусовки единомышленников, а стала «Конференцией 2.0», распределенной в пространстве и времени, собравшей в интернете на порядок больше зрителей, и с сontinuous обратной связью. И нам всем, очень важен feedback:

- Докладчикам, чтобы увидеть ошибки и получить новые идеи по теме — ведь многие из них будут рассказывать эти доклады и на других конференциях.

- Программному Комитету — мы уже собирались на ретроспективу, и будем делать это еще — чтобы понять, где мы ошиблись — в выборе докладчика или темы, где мы не доработали, рецензируя слайды или аудируя (или недоаудируя) докладчика.

- У нас есть первоначальный простой фидбек в виде олдскульного голосования разноцветными стикерами, по нему мы уже видим неожиданные результаты (потенциально сильный доклад собирает много красных стикеров), но понять — почему, этот инструмент не дает.

- Еще будут обработаны электронные анкеты участников… но в любом случае, это фидбек сильно ограничен и аудиторией, и нашей планировкой докладов по трекам — возможно интересный доклад попал в малый зал (из-за различных ограничений, включая расписание докладчика), и не собрал ожидаемую аудиторию… в общем, тут же будет равноценных доступ к любому из докладов, и нам интересны и ваши оценки, и желательно именно отзывы. Да, многие писали более-менее полноценные обзоры, но, увы, таких людей мало, а некоторые из них уже стали «профессиональными зрителями конференций», посещающими по десятку конференций в год, несколько пресыщенными («на мой взгляд, ничего нового-с…»), и оторванными от практики,… А хотелось бы именно Труѣ-фидбека, особенно от тех, кто нечасто бывает на конференциях по разработке.

- А еще лично мне, чтобы узнать, есть ли какие косяки в видеомонтаже — рассинхрон потоков, или выбранный план скрывает что-то важное («докладчик явно что-то важное показывает на экране указкой/рукой, а экран/рука закрыт скринкастом»), или тема и мысли ОК, но, скажем темп изложения усыпляющий — можно ускорить. Или наоборот, слишком шустро, не поспеваю — можно замедлить.

Или случайно спалили что-то секретное на слайдах (на прошлом AgileDays было, и на этом уже). Или про что-то проговорились («А я не знал, что записывают…»). Все это пока можно починить.

- И это нужно вам, зрителям — написать комментарий по просмотренному докладу — несложно, гораздо проще, чем писать полноценный отчет. Написание хотя бы одноабзацевого комментария — прекрасный метод рефлексии и запоминания основных мыслей доклада. Плюс, может получится интересная дискуссия, завязаться интересные знакомства, может там даже будут пастись хедхантеры.

Так какие же правила игры?

- Там, на каждой странице доклада из категории прикручена самая популярная система комментирования DISQUS — в нее можно логиниться любыми соцсетями и т.п., если их нет, полезно в ней завестись, все равно она прикручена к 80% всех комментируемых сайтов в инете.

- Просмотрев доклад — напишите хотя бы одноабзацный отзыв. На самом деле никаких ограничений нет, можно писать и кратко, можно и романы, но текущий ужасный тренд в том, что многие разучаются выражать свои мысли, заменяя это простым лайканьем, ознакомившись с заголовком, и хотелось бы этот тренд переломить. Т.е. да, можно писать и короче, можно и длиннее, можно написать отзыв в своем блоге, а сбросить только ссылку — как вам удобно. Заодно можно указать и на вышеперечисленные проблемы, если было что-то не ОК, причем указать точно — ведь во всех видео сейчас вшиты временные маркеры, однозначно определяющие момент (Не «Вырежи, где я где-то во второй половине доклада проговорился о наших заказчиках», а «плиз, вырежите 7:34:56-7:35:10»). И т.п.

- Особо я хочу выделить тех, кто действительно просмотрел весь доклад, ведь очень многие готовы написать отзыв вообще по заголовку и аннотации («Пастернака не читал, но осуждаю…»). Тут есть хитрость — во все видео вшиты в случайных местах слова, связанные с Agile-тематикой. Эти слова появляются на пару десятков секунд фиолетовым цветом по центру видео. Если вы просмотрели видео и увидели это слово — запишите его, и укажите его в комментарии — такие комментарии я выделю особо.

Ну и геймификация такова — я отберу топ тех, кто просмотрит больше всего видео, откомментировав его («собирая слова»), и обязательно придумаю, как нестыдно, материально или нематериально наградить. Среди идей — и «доски почета/hall of fames», и может удастся выбить скидки на следующее посещение AgileDays, а может целое приглашения, или приглашение на другие конференции пораньше, ну и я разыграю какой-нибудь набор полезных в образовании гаджетов — диктофоны например…, что-нибудь USB-полезное, +рюкзаки/сумки с символикой AgileDays… единственное с предметами может быть геморрой с пересылкой в другой город, очень хотелось бы обойтись самовывозом.

Собственно, в такие игры я играю впервые, не знаю — сработает ли, мне бы очень хотелось бы, чтобы да. Игра будет наверно в ближайшие пару недель, или целый месяц, это особенно ценное время, чтобы Программный Комитет и авторы могли осмыслить по свежим следам результаты, косяки видеозаписи, по крайней мере, в интересных докладах[6] были найдены. Потом я залью уже окончательные, возможно исправленные версии без временных маркеров.

Может действительно окажется, что комментировать непросто… ну в любом случае можно также и шарить-лайкать кнопками, это все тоже наверно хорошо и полезно, но как-то геймифицировать лайки мне кажется неэтичным — поэтому лайкате и шарьте только, если вам действительно понравился доклад.

Такие дела, если есть предложения по правилам — тоже welcomed, но мне кажется, идея неплохая, явно типа Win-Win.

Удачного просмотра!

|

- ↑ Где тоже были наши

- ↑ Особо рекомендуем докладчикам, чтобы работать над ошибками

- ↑ А еще я куда-то потерял две камеры и фотоаппарат…

- ↑ Очень хотели везде записать звук с микрофона, но тут нам выкатили

охунечеловеческий ценник — 800руб/час/трек за запись звука, и записать идеальных звук удалось только в одном зале, несанкционированно подключившись к системе - ↑ Есть еще парочка, которых нужно доделать, это вопрос пары дней

- ↑ Если будут косяки в докладах, которых никто не захотел смотреть… ну значит так звучит ломающееся дерево в лесу, в котором никого нет

Russian Open Source Summit

В пятницу, 11 апреля, будет проходить наверно крупнейшая российская конференция по свободному софту — Russian Open Source Summit.

Крупнейшая — по количеству участников, ибо посещение бесплатное, сняты огромные залы в крутом отеле в центре Москвы, там полдесятка треков, и бесплатный обед и плюшки.

Что же там будет классного (кроме плюшек и обеда) — сложно сказать уверенно, но зато, мы можем рассказать и показать, что там было в прошлом году.

Ведь за всю историю конференции, там не велась съемка, кроме как прошлом году, когда нас внезапно (вечер до) позвали снимать, и мы попробовали запечатлеть доклады.

Несмотря на кучу накладок[1] все доклады записаны, и вполне смотримы[2].

Но, понятное дело, мало кто хочет перебирать все видео в поисках интересного, поэтому мы предлагаем краткий обзор-отчет с нашей тематической классификацией, из которой возможно будут видны основные темы и тренды, спикеры и аудитория.

И так как боюсь, все равно получится «многобукф» — скажу главное — не важно, какие будут доклады, приходите все равно. Будет и тусовка, там будем мы со своим стендом, и парой докладов, можно будет пообщаться-пожаловаться, увидеть, что «слухи о моей смерти несколько преувеличены», предложить интересные идеи , узнать, почему это не работает…

Ждем вас! Только не забудьте зарегистрироваться — Russian Open Source Summit.

А теперь поехали, обзор прошлогодних докладов.

OpenVPN в линуксах — не rocket science, это должен уметь каждый

Итак, можно сказать, что времена массого заселения интернетов прошли успешно, минимальная компьютерная грамотность сегодня — умение запустить браузер и ориентироваться в вкладках-закладках, ссылках и поисковиках есть у всех.

Все это поддержалось тотальной WiFi-зацией пространства, и в целом, все привыкли, что Интернет — это некое единое магическое пространство, платоновский мир идей, к любому объекту которого которому можно всегда подключиться, если на ноутбуке-планшете-смартфоне горит значок сети или иконка веселой антенны.

Однако мир меняется, разные границы появляются и в интернете, и все чаще, можно получить удивительные ошибки «Ресурс заблокирован», «Это видео недоступно для вашей страны» и т.п. Кто только этим не занимается — Netflix и Hulu не хотят, даже за деньги[1] делиться контентом с Восточной Европой и Азией, ну, а про а про наши интернет-блокировки решениями районных судов тоже наслышаны все.

Впрочем, иногда ограничение доступа вполне оправдано, когда речь идет о доступе к корпоративному интранету — только доверенные сотрудники должны иметь к нему доступ. Но ведь этим сотрудникам хочется удобства и постоянного доступа, и не с привинченного к полу громоздкого десктопа в унылом офис-центре, а с своего любимого лептопа, в любой момент, из дома, вайфайзированного кафе или парка, и прочего цивилизованного пространства («дом, это то место, где WiFI подключается автоматически»). В общем, BYOD-тренд заруливает.

Все эти задачи — как протуннелировать в другую сеть, и стать для интернета «голландцем» или «американцем», или наоборот,

попасть в свою внутреннюю сверхзащищенную сеть, или даже просто — вырваться из недоверенной сети, где твои пароли могут прослушать — решают VPN-технологии, и здесь мы не будем говорить прописных истин о том, как это работает, почему это надежно, о тонкостях алгоритмов шифрования, сертификатах, heartbleed, капусте, Королях и т.п., а расскажем о том, как это для выглядит для пользователя в наших дистрибутивах.

Да, подавляющее большинство VPN-сетей кстати тоже сделаны на базе open-source технологий OpenVPN[2], и там очень много гитик, как все это настраивать — сертификаты, ключи, конфиги, под винду надо ставить специальный софт, с глючными драйверами, в общем, сам в свое время писал регламенты подключения удаленным сотрудникам, ставил все это, офигевая от сложностей объяснения, ну а большинство пользователей запомнили, что «випиэн» — это какой-то рокетсайнс, и надо звать бородатых чуваков в растянутых свитерах[3], ибо само не заработает.

В GNOME же все это работает из коробки! И не нужно знать практически ничего.

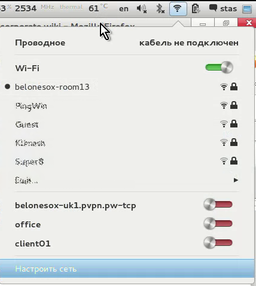

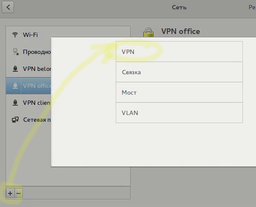

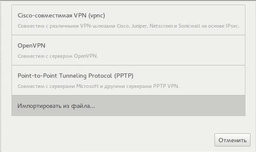

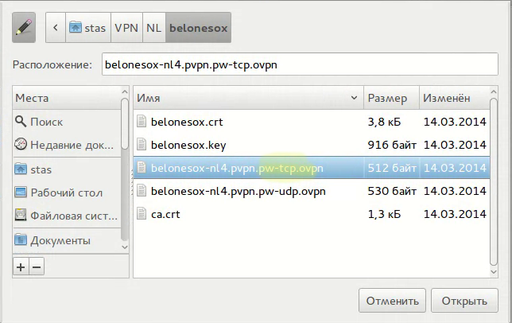

Допустим, вы решили вырваться в Атлантический Интернет — арендуете за $1/месяц какой-нибудь ProstoVPN[4], вам присылают набор каких-то файлов (файл-конфигурации и всякие ключи — не глядя положите-распакуйте их куда-нибудь, где вы их не сотрете, и запустите «Настроить сеть» → «+» → «VPN» → «Импортировать из файла»

Тут уже выберите файл с расширением «*.ovpn» или «.config», это зависит от фантазии сисадминов или провайдера, и если есть выбор между «что-то TCP» и «что-то UDP», то, в любой такой непонятной ситуации выбирайте «что-то TCP».

Все, ничего не трогая руками, можете смело жать кнопку «Добавить».

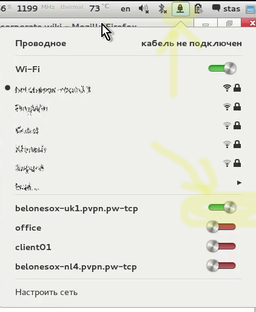

Ура! У вас в выпадающем списке сетей появился еще один слайдер-переключатель для защищенной сети, и достаточно переключить его, как иконка сети превратится в замочек, а вы, согласно сервисам, типа http://internet.yandex.ru, смените место жительства.

Итак, все замечательно, работает из коробки, зачем же я начал писать статью… А, конечно нет. Не все. Без напильника и наших доработок конечно не обошлось.

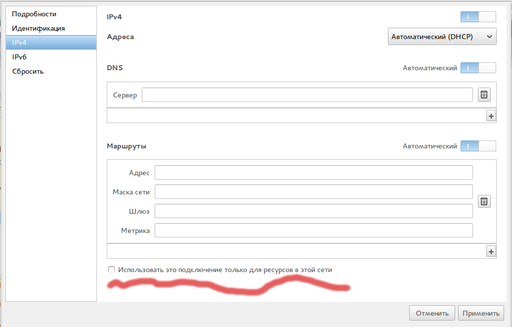

Да, обычный VPN, когда весь трафик мы выбрасываем через выбранную точку, работает ОК, но при доступе к корпоративным частным сетям нужно несколько другое — чтобы только в корпоративную сеть шли только обращения за внутренними сайтами, всякими там *.office.supercompany.ru, а гугл-яндекс-вконтактик по-прежнему работали с вами напрямую.

Технически, это означает, что маршрут по умолчанию не должен меняться (см. первую строчку таблицы)

[stas@stas-HP2740p-grey test-openvpn]$ netstat -rn Kernel IP routing table Destination Gateway Genmask Flags MSS Window irtt Iface 0.0.0.0 10.168.0.1 0.0.0.0 UG 0 0 0 wlan0 10.9.0.0 10.9.0.5 255.255.255.0 UG 0 0 0 tun0 10.9.0.5 0.0.0.0 255.255.255.255 UH 0 0 0 tun0

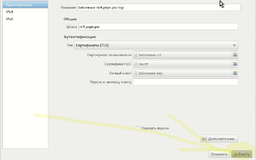

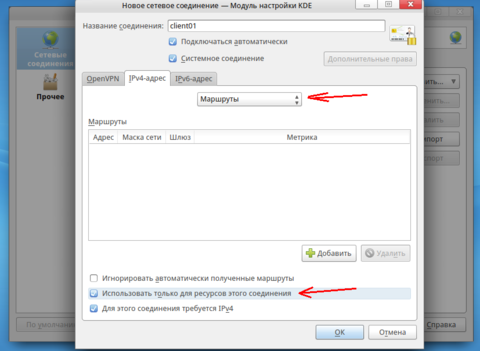

А практически, для этого в GNOME Network Manager нужно было поставить одну галочку:

Но это не работало! Галочку «использовать это подключение только для ресурсов локальной сети» ставили, но она не запоминалась, и соответственно, все работало по прежнему, через… туннель.

Пришлось разбираться и фиксить — оказалось да, глупая UI-ошибка, когда изменение этого чекбоксика формой не отслеживалось, это изменение не запоминалось, ну и так далее.

Good news, everyone!

UX Team пофиксил и это, и у нас OpenVPN в GNOME работает из коробки и как должно — просто, легко, и надежно.

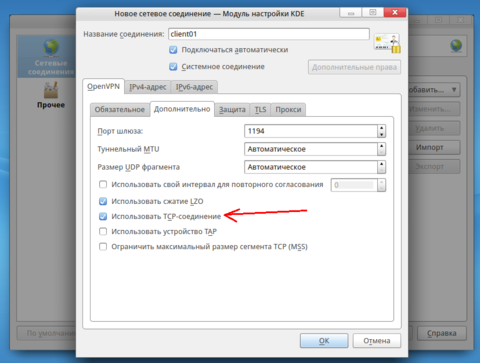

А, что касается KDE — там тоже все ОК, допиливать не пришлось, и примерно также.

Тоже не надо забывать установить правильную галочку про частные сети, и про использование TCP-соединения:

Здесь могла бы быть реклама вашего VPN-сервиса

|

- ↑ Когда я тестировал работоспособность платных DRM-каналов, см. Blog:Точка Росы/Из всех искусств для нас важнейшим является кино…, я оплачивал доступ к этим ресурсам… и так получилось, что как-то забыл отписаться от Hulu — и оно несколько месяцев доило мой карточный счет, а чтобы отписаться, пришлось пройти нетривиальный квест… :(

- ↑ И кровавыми слезами плачут пользователи разных малораспространенных вендорских решений

- ↑ Ну или тыжпрограммиста

- ↑ Это бесплатная реклама

Развиваем и KDE! Нескучные обои — сразу из браузера

Обои для рабочего стола. Казалось бы, элементарная вещь, но сколько шума и проблем связано с ними у линукс-дистрибутивов.

С одной стороны, Труѣ-линуксоиды считают недостойным само размышление на эту тему, что лучше всего отражено в следующем коане:

Как-то Сисадмин спросил:

— Учитель, не желаете ли красивую картинку для вашего десктопа? У меня есть коллекция «обоев для рабочего стола» со звёздным небом и моральным законом.

— Почему ты думаешь, что мой нынешний «wallpaper» хуже? — спросил в ответ Инь Фу Во.

— Я не знаю, какая у вас картинка сейчас. Я никогда не видел вашего десктопа. У вас всегда открыто множество окон.

— Я тоже его никогда не видел, — сказал почтенный Инь. — Я работаю.

С другой — почему-то выбор обоев для дистрибутива считается чуть ли не системообразующим фактором, порождающим кучу самоделок с «нескучными обоями», ну и часто, при поверхностных[1] обзорах дистрибутивов, основное все впечатление по дизайну обосновывается скриншотами прибитых по умолчанию обоев, что на самом деле, также осмысленно, как оценивать покупаемую квартиру по обоям.

С третьей — невыразимый ѣ-стыд охватывает, когда ставишь KDEшный Linux девушке/жене и видишь, что самое первое, что делает типичный «female user» — это пытается придать уют, пытаясь сменить обои рабочего стола, неважно, были ли они специально страшные, или специально разрабатывались целым отделом дизайна. И не может. Ведь те, кто меняет обои в KDE, знают, что это совершенно неочевидный процесс, который нельзя понять, можно только запомнить, и состоит из странных действий, связанных с файловой возней («файловой» — значит уже неочевидной «нормальному пользователю») или какими-то странными KDEшными каналами их получения.

При том, что даже ребенку, выпущенному в интернет, понятно, что именно там находится тот самый неисчерпаемый источник красивых обоев (Яндекс, Google), где можно их выбрать и по ключевым словам, темам, популярности и адаптированным под нужное разрешение. Впрочем, в интернете уже все хранят даже семейные фотоальбомы, если кто захочет радовать себя фотками родных на рабочем столе — он тоже будет ставить их из браузера.

И не нужно ни странных методов настройки, закопанных в глубины центров управления, ни странных «wallpaper stor-ов», нужно лишь одно, чтобы работала стандартная функция браузера, контекстое меню на картинке → «Сделать обоями рабочего стола».

Такая штука уже работала в GNOME (хотя не совсем ОК, об этом дальше), но ее не было в KDE, а соответствующие баги мирно тухли уже лет пять.

Good news, everyone!

Наш KDE-эксперт, Андрей «Pulfer» Бондров, наконец-то закрыл страницу этого позора, запатчив KDE, KMozillaHelper и Firefox.

Теперь и KDEшный ROSA Fresh можно без стыда поставить девушке и ребенку. И умильно наблюдать, как ваша жена, перебирает для обоев ваши фотографии… чтобы потом выкинуть их и поставить что-нибудь по-настоящему красивое[2].

И кстати, по нашим прошлым постам в «Точке РОСы» могло сложиться впечатление, что работа идет только по GNOME-версии, а KDEшная версия заброшена — уверяем вас, это не так.

И сделанные патчи по обоям уже отправлены в апстрим, и можно надеятся, с учетом предыдущего опыта небыстрой KDE-адаптации, что через пару лет эти фичи будут во всех KDE-дистрибутивах.

Кроме доработок апстримого KDE много исправлений делалось и в наших KDE-продуктах — ROMP, SimpleWelcome… описывать исправленные ошибки как-то наверно скучно, хотя там были исправлены и очень неприятные проблемы, например, когда пользователь проигрывал видео с подключенных сетевых хранилищ (FTP и т.п., как описано в Blog:Точка Росы/Из всех искусств для нас важнейшим является кино…), система, ради красивого тамбнейла вытаскивала целиком видеофайлы в /tmp, забивала его полностью и происходило много-много неприятностей. В общем, и с этим «чудовищем, которое преследовало ваш род» было покончено.

Впрочем, насчет обоев, мы еще не закончили. Ведь пришлось делать доработки и в GNOME, где, казалось бы, все должно было работать из коробки. Так казалось мне, и наверное всем гномо-пользователям. Мужского пола. Ведь мужской выбор (если все-таки лень вообще что-то менять удалось победить) — это неторопливый выбор подходящей картинки в браузере, установка ее, и все. Забываем на годы.

Как выяснилось, наблюдая за женским выбором — он не таков. Картинка выбирается, на нее смотрят, ставят на рабочий стол… живут с ней несколько минут… после чего «нет, что-то не очень» и идем переклеивать обои заново. Хорошо, что не в квартире, но каково же было мое удивление, когда мне сообщили «WTF? Обои меняются только четыре раза, а потом все, надо перезагружаться». Такие странные физические ограничения для электронных артефактов обычно вводят в удивляющий ступор, заставляя вспомнить разные истории, про «email, который идет не дальше 500 миль» и т.п.

Оказалось да, там была вполне реальная проблема, связанная с именованием выбранной из браузера картинки, кешированием, и отслеживанием изменений… — и UX Team успешно зафиксил и ее.

Так что теперь, и ROSA GNOME Fresh и ROSA KDE Fresh можно смело ставить девушкам, женам и детям…

Остается только ROSA LXDE Edition, где и браузерно-обойная проблема еще не решена, и выбор обоев по умолчанию, у многих пользователей вызывает … некоторое удивление[3]… но будем пока считать это не багом, а фичей, и лично я, ROSA LXDE поставил на лептопы тестю и теще[4].

|

- ↑ А таковых — большинство

- ↑ My true sad story :(

- ↑ Даже политкорректные англоязычные пользователи признаются «Now to be honest, the default wallpaper doesn't do much for me. Actually it probably almost fried my eyes and shot me back to the 90's at the same time…»[1]

- ↑ Разумеется, я не зверь, и обои по умолчанию сменил на нестыдные, а тяги к перемене обоев в их возрасте уже нет

Графический интерфейс для urpmi.recover

На прошлой неделе мы отправили в репозитории urpmi.recover, способный откатывать состояние пакетной базы в прошлое. Новая утилита уже нашла своих пользователей, которые, в свою очередь, нашли в ней некоторые шероховатости:) Впрочем, систему urpmi.recover никому не убил, данные не потер, а найденные недочеты мы оперативно исправляем. Но хотим напомнить, что текущий urpmi.recover пока надо рассматривать как бета-версию, недостаточно оттестированную и не готовую к повсеместному промышленному использованию.

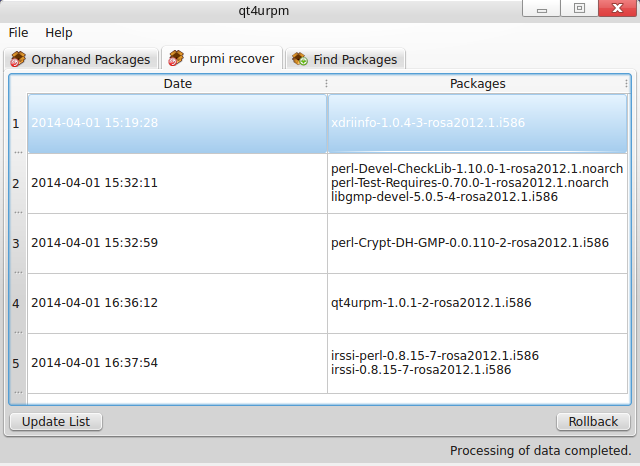

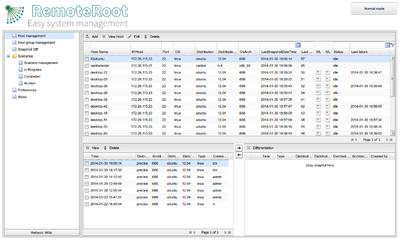

Неожиданные результаты работы urpmi.recover иногда происходят из-за того, что в командной строке не очень-то удобно определять, на какую дату следует откатиться или сколько транзакций надо отменить для возврата системы в рабочее состояние. Для решения этой проблемы, мы на скорую руку соорудили для urpmi.recover простенький графический интерфейс — а точнее, добавили его поддержку в утилиту qt4urpm.

Qt4urpm — это небольшая программа, написанная несколько лет назад участниками сообщества MandrivaUser.de для двух операций с репозиториями urpmi — поиском в них файлов и определения и удаления осиротевших пакетов (то есть пакетов, которые были когда-то установлены в систему для удовлетворения зависимостей других пакетов, но необходимость в которых с тех пор отпала — например, потому что зависящие от них пакеты были удалены). Конечно, схожую функциональность предоставляет и графический Rpmdrake, однако qt4urpm — гораздо более легковесная программа (написанная на Qt) с очень простым интерфейсом, но в то же время нередко более удобная в плане стоящих перед ней задач — например, здесь можно удалять только определенные пакеты-сироты, а не все сразу, как в Rpmdrake, при этом выполнение типичных действий требует максимум трех кликов мышкой.

В общем, мы решили, что простой и прямолинейный интерфейс для urpmi.recover хорошо впишется в qt4urpm и оперативно это дело реализовали. Устанавливайте свежую версию (2.0) пакета qt4urpm, запускайте программу и переходите на вкладку urpmi.recover. Здесь будут перечислены транзакции, отсортированные по дате, и для каждой транзакции указывается перечень установленных во время ее выполнения пакетов:

Выбирайте интересующую вас дату/транзакцию и жмите Rollback — и urpmi.recover откатит все транзакции, начиная с выделенной.

В будущем, возможно, наши специалисты по приложениям с графическим интерфейсом создадут что-нибудь более красивое и эстетичное, но в плане функциональности qt4urpm предоставляет все необходимое. Надеемся, он позволит вам избежать путаницы в транзакциях rpm и более удачно рассчитывать эффекты от отката пакетной базы.

|

В помощь мэйнтейнеру - spec-cleaner и rediff patch

Работа мэйнтейнера включает в себя много рутинных операций — адаптацию spec-файлов под изменяющиеся политики и инструменты сборки, переделку патчей под новые версии пакетов, обновление списка файлов приложения в пакете и так далее. Много рутины берет на себя инструментарий сборки — сам rpmbuild и вспомогательные скрипты из пакета spec-helper. Однако эти скрипты по определению не могут выполнить ряд задач — например те, которые требуют внесения изменений в spec-файлы.

Чтобы несколько облегчить жизнь мэйнтейнеров, мы включили в пакет spec-helper два новых скрипта, которые не применяются автоматически при сборке, а предназначены для ручного запуска человеком. Полагаю, названия скриптов говорят сами за себя — spec-cleaner и rediff_patch. Обновите в своей системе spec-helper, и эти скрипты появятся у вас в /usr/bin.

Spec-cleaner выполняет следующие действия:

- удаляет устаревшие и ненужные декларации — например, определение BuildRoot и Packager, зависимость от install-info, очистку buildroot и так далее;

- изменяет оформление использования макросов и переменных — переменные печатаются в фигурных скобках — %{const}, а макросы — без них — %{macro}. Такие изменения производятся только для макросов и переменных, определенных в самом rpm (а точнее, перечисленных непосредственно в скрипте spec-cleaner). Если вы сами определяете какие-то сущности, то их оформление скрипт изменять не будет;

- изменяет форматирование Summary — делает первую букву заглавной, удаляет точку в конце;

- удаляет явные определения переменных %{name}, %{version} и %{release};

- заменяет устаревшие макросы на современные аналоги;

- … и много других мелочей.

Пользоваться spec-cleaner — проще простого:

spec-cleaner my.spec

Если вы не хотите, чтобы изменения делались непосредственно в spec-файле, то можно указать второй параметр — имя нового spec-файла:

spec-cleaner old.spec new.spec

При разработке spec-cleaner мы старались прежде всего избежать ситуаций, когда новый spec-файл окажется некорректным — поэтому некоторые недочеты spec-файлов, исправление которых кажутся тривиальными, пока не реализованы.

Rediff_patch, как нетрудно догадаться, переделывает (точнее, пытается переделать) имеющийся патч под новую версию тарболла с исходным кодом. Прежде, чем пытаться использовать этот скрипт, внимательно прочтите инструкции ниже:)

- запускать rediff_patch необходимо в директории склонированного проекта — там, где лежит spec-файл и патчи. Spec-файл используется для того, чтобы определить — как именно применяется патч;

- в эту же директорию необходимо поместить новый тарболл с исходным кодом, для которого надо переделать патч;

- непосредственно запуск скрипта выглядит так:

rediff_patch <patch_ro_rediff> <tarball>

Если у вас в директории только один тарболл, то второй параметр можно опустить — rediff_patch возьмет единственный тарболл самостоятельно.

В ходе работы rediff_patch создаст директорию rediff_patch, распакует в нее новый тарболл и попытается применить к нему патч с параметрами, взятыми из spec-файла, добавив к ним опцию «--force» и используя значение fuzz по умолчанию (при сборке в rpmbuild используется «--fuzz=0»). Сейчас скрипт рассчитан на работу с тарболлами, при распаковке которых получается одна директория — обрабатывать tar-бомбы он откажется. В случае, если все сложится успешно, рядом с вашим патчем вы обнаружите новый патч с суффиксом «.new», а остальные следы деятельности скрипта (директория rediff_patch со всем содержимым) будут уничтожены. Если же что-то не заладится (например, патч применился не целиком), то вам останется директория rediff_patch с двумя поддиректориями — исходной и новой, к которой пробовали применить патч. Так что вы сможете вручную завершить работу, которую не получилось сделать автоматически, и уже самостоятельно сформировать новый патч с помощью стандартного diff -Naur.

Практика показывает, что большинство патчей все-таки требуют доработки, переделать их автоматически с использованием --force и более мягкого значения fuzz получается не очень часто. Однако даже если rediff_patch справился со всем самостоятельно, обязательно проверьте результирующий патч — ведь '--force' иногда может привести к нежелательному результату. А если rediff_patch не справился — что ж, по крайней мере, мы немного сэкономим на распаковке архива и первой попытке применить патч.

Оба скрипта довольно просты и прямолинейны. Как всегда, приветствуются отзывы, предложения, а главное — патчи:)

Urpmi.recover - машина времени для пакетной базы

Многие разработчики и любопытные пользователи нередко сталкиваются с необходимостью откатить недавно установленные пакеты, которые привнесли в их систему не совсем ожидаемые обновления. Это обычно случается при установке пакетов из неофициальных источников, из testing-репозиториев или просто из частных репозиториев разработчиков и контейнеров, содержащих пакеты исключительно для тестирования. Последнее особенно актуально для нашей команды QA — откатывать установленные для тестирования пакеты им приходится очень часто.

Откатывать пакеты вручную не очень удобно, особенно если их много и вы не вполне уверены, что именно надо откатить для возврата системы в нормальное состояние. На помощь может прийти urpm-reposync, но этот инструмент может оказаться слишком мощным — он осуществит полную синхронизацию вашей системы с подключенными репозиториями, и откатить только часть пакетов с его помощью затруднительно.

Хорошая новость — теперь ниша между ручным откатом пакетов и использованием reposync заполнена утилитой urpmi.recover, способной откатывать установленные вами пакеты. Urpmi.recover может вернуть пакетную базу в состояние на определенную дату в прошлом, либо откатить заданное количество транзакций по установке пакетов.

Urpmi.recover является частью пакета urpmi и автоматически попадет в вашу систему с обновлениями.

Для осуществления такого отката пакетов, urpmi.recover сохраняет старые версии обновляемых пакетов в директории /var/spool/repackage. И для того, чтобы начать пользоваться утилитой, необходимо сначала инициализировать сохранение старых версий пакетов, выполнив команду

# urpmi.recover --checkpoint

Этой командой вы как-бы говорите: «Сейчас у меня система в стабильном состоянии, но я собираюсь установить потенциально опасные пакеты. Пожалуйста, начиная с этого момента, отслеживай все устанавливаемые пакеты и сохраняй их старые версии в случае обновления».

Вы можете выполнять эту команду и в будущем для переопределения стабильного состояния системы. При этом при каждом вызове urpmi.recover --checkpoint директория /var/spool/repackage будет очищаться, так что откатиться на более раннюю дату вы уже не сможете.

Пока отслеживание установки и обновления пакетов включено, старые версии пакетов сохраняются в поддиректориях /var/spool/repackage, соответствующих дате обновления, так что вы всегда можете изучить эти пакеты самостоятельно.

Если в некоторый момент времени вы решаете, что настало время откатить систему в прошлое, то просто выполните команду

# urpmi.recover --rollback <timestamp>

Время отката можно указать как число секунд с начала Эпохи, но для людей предусмотрены и более удобные варианты, например:

# urpmi.recover --rollback "2014-03-07 13:20:47"

или даже так:

# urpmi.recover --rollback "1 hour ago"

Можно откатить и заданное количество транзакций, указав опцию --transactions и передав количество транзакций для отката опции --rollback:

# urpmi.recover --transactions --rollback <число_транзакций>

В частности, если вы только что установили пакет (который притянул кучу зависимостей), то вы можете просто откатить это обновление, выполнив

# urpmi.recover --transactions --rollback 1

Наконец, отключить отслеживание установки пакетов вы можете командой

# urpmi.recover --disable

Эта команда также очистит /var/spool/repackage.

Вот так с помощью urpmi.recover можно откатывать состояние пакетной базы. Утилита находится в экспериментальном состоянии и отсутствие ошибок не гарантируется, тестируйте на свой страх и риск:). Впрочем, перед осуществлением отката urpmi.recover сообщит вам, что именно он собирается сделать (какие пакеты удалить, какие откатить), и у вас будет возможность отказаться, если вам что-то не понравится. Наконец, в случае чего, urpm-reposync готов прийти на помощь.

Также стоит помнить, что мэйнтейнеры не всегда заботятся об обеспечении корректного отката пакетов на предыдущие версии — так что если новая версия пакета вам что-то сломала в системе, то откат на старую может и не помочь.

Новости ABF - новые возможности консольного клиента, поиск по Advisory и другие радости

ABF — один из ключевых компонентов разработки всех дистрибутивов РОСЫ (и не только), а вот новости про него в «Точке РОСЫ» проскакивают редко. Англоязычные пользователи могут читать новости в блоге ABF, а вот для русскоязычной аудитории мы постараемся восполнить недостаток известий в нашем блоге.

Итак, вкратце основные улучшения ABF за последний месяц.

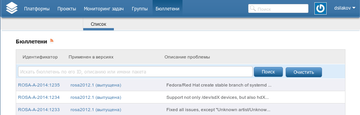

Во-первых, мы улучшили поиск по Бюллетеням (Advisories) в веб-интерфейсе. Теперь вы можете искать бюллетень не только по его идентификатору, но и имени пакета и по описанию бюллетеня (в которое обычно включают ошибки, исправляемые обновлением — в том числе и проблемы с безопасностью со ссылкой на соответствующий CVE).

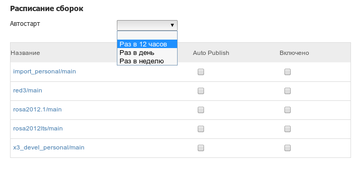

Во-вторых, мы добавили возможность регулярной сборки проектов по расписанию. В настройках проекта теперь есть раздел, где можно указать — в какие репозитории и с какой периодичностью надо собирать пакеты.

Из других улучшений в веб-интерфейсе можно отметить возможность автоматической публикации в testing-репозиторий. Теперь можно либо явно запретить автопубликацию, либо опубликовать пакет в testing-репозиторий, либо выбрать пункт «По умолчанию» — в последнем случае автопубликация будет производиться (или не производиться) в соответствии с настройками репозитория.

Наконец, консольный клиент ABF также получил ряд полезных функций. Теперь с помощью клиента вы можете создавать проекты на ABF из локальных SRPM-пакетов, клонировать проекты и приписывать/убирать проекты к репозиториям.

Клонирование проекта осуществляется с помощью команды fork, которой необходимо указать имена исходного и целевого проектов, включая владельцев:

abf fork dsilakov/foo import/bar

Для создания проекта из SRPM-пакета, дайте клиенту команду «create», указав SRPM-пакет для импорта и имя владельца, для которого будет создан проект (владельцем может быть как пользователь, так и группа, но у вас должны быть соответствующие права на создание проектов):

abf create foobar.src.rpm import

Имя и описание проекта будут взяты из соответствующих тегов пакета.

Такая возможность оказалась особенно удобна для импорта большого числа пакетов. Загружать их по одному через веб-интерфейс — долго, для массового импорта через веб пакеты надо сначала выложить на какой-нибудь публично доступный сервер, а с помощью клиента можно все провернуть в одну строчку:

for p in *rpm; do abf create $p import; done

Плюс к этому, консольный клиент теперь может добавлять и удалять проекты из репозиториев посредством команд add и remove:

abf add -p import/foobar rosa2012.1/contrib abf remove -p import/foobar rosa2012.1/contrib

Если вы находитесь в директории склонированного проекта import/foobar, то указание его имени с помощью опции «-p» можно опустить.

Напоминаем, что пожелания по улучшению ABF всегда приветствуются на трекере идей и пожеланий.

|

FOSDEM 2014 - Свободное ПО в Европе

За два дня FOSDEM посетило несколько тысяч человек — организаторы дают расплывчатую оценку «5000+», но поскольку вход абсолютно бесплатный, свободный и не требует никакой регистрации, то точное число узнать вряд ли получится. Посчитать посетителей можно только косвенно — например, по количеству подключений к dhcp-серверам wifi-сети. К слову, wifi работал без нареканий, но организаторы решили провести эксперимент и основную сеть сделали IPv6-only. Судя по достаточно большому количеству вопросов от людей, которые вроде бы подключались к wifi, но до интернета достучаться не могли, далеко не все настольные системы на данный момент готовы переехать на IPv6 прозрачно для пользователей. Впрочем, организаторы сжалились, параллельно развернули сеть с IPv4.

Возвращаясь к количеству посетителей, цифра 5000 на самом деле может оказаться и заниженной. Ведь всего на конференции было около полутысячи докладов, презентаций и круглых столов (и значит, почти столько же докладчиков). Доклады шли параллельно в 23 аудиториях, каждая из которых вмещала минимум несколько десятков человек, а многие — и несколько сотен. Конечно, на некоторых докладах залы были заполнены процентов на десять, но на некоторых из тех, что я посетил, было более двухсот слушателей.

К тому же помимо докладов, народ активно изучал стенды представленных на конференции проектов и общался с разработчиками. Стендов было 45 штук, и пообщаться было с кем. Из дистрибутивов помимо OpenMandriva были представлены Fedora, OpenSUSE, Debian, Mageia, а также дистрибутив для детей — DoudouLinux. Представлявший его товарищ сам похож на большого ребенка, так что есть основания полагать, что он знает, что делает:) Интересно полное отсутствие Ubuntu, хотя на машинах для общего пользования, стоявших в коридорах, была установлена именно эта ОС. Коммерческий Red Hat как дистрибутив тоже представлен не был, однако сама компания являлась основным спонсором конференции и ее сотрудники представили достаточно много докладов про открытые технологии, продукты и процессы, развиваемые и используемые в крупнейшем коммерческом Linux-вендоре.

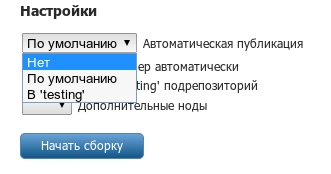

В частности, были несколько докладов от разработчиков Foreman — нового инструментария для управления пулом серверов (как реальных так и виртуальных и витающих в облаках). Foreman предоставляет средства развертывания ОС на множество серверов и интегрируется с системами управления конфигурацией — на конференции рассказывалось о Puppet и Chef. Авторы также обещают интеграцию с Katello — в совокупности с системой управления репозиториями Pulp эти продукты должны прийти на смену Spacewalk/Satellite в будущих поколениях RedHat Networks. Правда, пока что интеграция Foreman с Katello сводится к наличию ссылок на интерфесый друг друга. Pulp на данный момент умеет работать только с репозиториями, созданными с помощью createrepo, но разработчики высказали заинтересованность в поддержке других платформ. Внутри РОСЫ мы уже сделали вполне работоспособную поддержку urpmi-репозиториев в Pulp — теперь на очереди общение на эту тему с апстримом. Может, подскажут — как сделать еще лучше:)Помимо рассказов о продуктах и технологиях (большинство из которых так или иначе были связаны с облачными технологиями и обслуживанием большого количества машин), представители RedHat делились некоторыми подробностями внутренней кухни компании и процессов разработки. Можно было узнать, что инженеры RedHat активно используют Gerrit для инспекции исходного кода, Nitrate для управления тестами, Dogtail для автоматизации тестирования приложений с графическим интерфейсом. Автоматизации тестирования вообще уделялось достаточно много внимания, ведь компаниям, предоставляющим коммерческие услуги, необходимо заботиться о качестве своих продуктов. А как показывает практика, полагаться в сфере тестирования исключительно на сообщество — не самый хороший вариант. Поэтому над тестами в RedHat работают активно, и по возможности стараются все автоматизировать.

Прогресс в этой области, безусловно, есть, и автоматические тесты активно используются для регрессионного тестирования различных приложений — как консольных, так и графических. Например, был неплохой доклад про cwrap — обертку для libc, позволяющая тестировать клиент-серверные приложения без развертывания реальной сети и виртуальных машин. Для тестирования GUI разработчики используют AT-SPI, что позволяет не привязываться к внешнему виду приложений, темам DE и прочим элементам оформления, не имеющим отношения к функциоанлу программы. Теоретически, это делает возможным использование одних и тех же тестов для разных версий одного и того же приложения в разных версиях ОС, но и здесь есть нюансы — например, при изменении структуры меню все равно придется модифицировать тесты, имитирующие клик на тот или иной пункт. В общем, забот по поддержке автотестов у RedHat хватает, но компания считает эти затраты обоснованными и смотри в будущее с оптимизмом. А заодно планирует в будущем «привить» культуру разработки с автоматическим тестированиям в Fedora.

Представители других дистрибутивов докладов особо не делали, хотя, я думаю, товарищи из SUSE тоже могли бы рассказать много интересного. Зато был показательный доклад от Debian, вполне дающий представление о процессе разработки этого дистрибутива — доклад назывался Reproducible Builds for Debian и, как нетрудно догадаться, был посвящен проблеме невоспроизводимости сборок многих пакетов в этой системе. То есть на основе одного и того же исходного кода и при использовании штатных инструментов Debian у разных разработчиков могут получиться несколько различные приложения, а какой из них попадет в репозитории — загадка. Так что исправив небольшую ошибку и пересобрав пакет, мэйнтейнер может случайно внести в него и еще ряд изменений по сравнению с предыдущей версией, обусловленные изменением сборочного окружения. Наличие проблемы создатели Debian признают, но вместо создания единой среды сборки типа ABF, OBS или Koji, которая была бы единственным источником пакетов в репозиториях, они предпочитают работать над «допилкой» инструментов сборки. Согласно тезисам доклада, после некоторой доработки инструментария в ходе массового эксперимента в сентябре идентичность сборок была достигнута для 1200 из 5000 пакетов. Авторы считают это неплохим достижением и потихоньку двигаются вперед.

Немало было обсуждений еще одной вечной темы — нивелирования различий между дистрибутивами для разработчиков приложений и вендоров. Ведь далеко не все разработчики горят желанием тестировать свои творения во всех существующих системах, но при этом нередко с подозрением относятся к мэйнтейнерам, видоизменяющим их продукты. Как сказал в кулуарах один из апстрим-разработчиков: «We need a way to protect us from maintainers». Впрочем, каких-то серьезных подвижек в этой сфере пока не предвидится. Как не предвидится их и в смежной проблеме распространения приложений — ведь собирать пакеты под каждый дистрибутив достаточно накладно, даже если использовать среды наподобие ABF или OBS, а сделать что-то универсальное, способное корректно устанавливаться в любой ОС — совсем непросто. На FOSDEM в очередной раз «всплыл» проект Listaller, три года назад слившийся с Autopackage, а сейчас активно поглядывающий на AppStream.

Для достижения кросс-дистрибутивности Listaller использует в качестве бэкенда хорошо известные PackageKit. Для решения проблемы зависимостей автор Listaller, не мудрствуя лукаво, предложил статически линковать приложение со всем, чем нужно. Вопрос отслеживания ошибок/уязвимостей в библиотеках, которые оказались встроены в приложение? Ну да, хороший вопрос, ну так что поделать — такова цена универсальности, придется в случае багов в библиотеке пересобирать и обновлять приложение. Заодно автор объяснил ненужность всяких post-скриптов в пакетах, пообещав, что Listaller выполнит все, что надо, автоматом — запустит ldconfig в случае установки библиотеки, перезапустит http-сервер при установке веб-приложения и так далее. В общем, Listaller умеет делать примерно то же самое, что файловые триггеры в нашем rpm5. А опыт использования файловых триггеров показывает, что несмотря на все свое удобство, предусмотреть все возможные ситуации и совсем избавиться от post-скриптов они не позволяют даже в рамках одного дистрибутива. Да и кросс-дистрибутивность многих файловых триггеров тоже вызывает сомнения.

В общем, подход Listaller на деле оказывается даже более ограниченным, чем способ, рекомендованный стандартом Linux Standard Base (LSB) еще десять лет назад. LSB рекомендует создавать пакеты формата RPM (и устанавливать их в debian-based системах с помощью alien), не делать никаких внешних зависимостей, кроме «lsb» (а любой дистрибутив, совместимый со стандартом, эту зависимость предоставляет), но при этому советует статически линковать только те библиотеки, которые не входят в LSB. Так что по крайней мере можно не линковать статически Qt, Gtk, ALSA и другие распространенные библиотеки.

Как итог — несмотря на долгую историю развития, ни Listaller, ни Autopackage, ни AppStream пока не снискали большой популярности у вендоров приложений. Однако актуальность проблемы никуда не делась, и искать какие-то пути ее решения надо.

Наконец, отмечу, что все больше разработчиков приходит к мысли, что большинству пользователей вообще-то без разницы, как устроены пакеты в репозитории — они всего лишь хотят устанавливать себе готовые приложения, а что такое «пакет» им и знать не обязательно. И постепенно начинают обдумывать, как бы пользователям предоставить что-то проще пакетного менеджера — например, Центр Приложений, как у Ubuntu. Так что и наш разрабатываемый Software Center вполне в общем тренде, только гораздо ближе к завершению, чем задумки большинства зарубежных коллег.

Немало интересного можно было узнать и на стендах. Разработчики KDE показывали будущий KDE5 — правда предупреждали, что на экране работают только часы и кнопка «Пуск» . На вопрос о Kiosk, который многие находили полезным для enterprise-использования, но который не был перенесен в KDE4, разработчики ответили просто — никто из активных участников проекта KDE не заинтересован в Kiosk, и даже не совсем не в курсе, что точно от него требуется. Так что если вы хотите допиливать Kiosk — you are welcome. А то, мол, все только жалуются на его отсутствие, а помочь сделать не хотят. Да и вообще — Kiosk на самом деле можно использовать в KDE4, правда GUI у него работать не будет:)Разработчики Gnome высказывали схожий подход к просьбам пользователей — ведь в Gnome тоже неплохо знают, что этим пользователям нужно, а если чего-то не хватает — patches are welcome.

На стенде MySQL и Percona можно было обсудить состояние MySQL, его перспективы и взаимосвязь с MariaDB. Представители Percona со скепсисом отнеслись к слухам о возможном свертывании активности самого MySQL и сказали, что не очень понимают тенденцию дистрибутивов переезжать на MariaDB (конечно, если не считать того аспекта, что MySQL — продукт классового проприетарного врага, а MariaDB вроде как поближе к сообществу). Сама Percona стабильно базируетсяна кодовой базе MySQL, никаких проблем с исправлением ошибок и уязвимостей не наблюдает и переходить на MariaDB не собирается. Может, немного лукавят, но возможно они и правы. В конце концов, я бы не сказал, что во время пребывания MySQL под крылом Sun жизнь в нем кипела, а потом прекратилась. В проекте по развитию инфраструктуры LSB мы использовали MySQL очень активно, и временами натыкались на ошибки, которые висели в баг-трекере MySQL годами, сталкивались с регрессиями и вообще старались очень аккуратно подходить к обновлениям MySQL. С переходом MySQL под крыло Oracle не заметили каких-то ухудшений в этой ситуации; впрочем, насчет улучшений утверждать тоже не берусь, но и насколько лучше в этом плане MariaDB — тоже вопрос открытый.

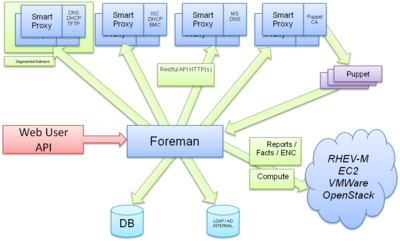

Интересной оказалась секция, посвященная свободным текстовым процессорам, где рассказывали далеко не только про Libre- и OpenOffice. Скорее можно было узнать, что для многих других проектов эти монструозные офисные пакеты выступают хорошей площадкой для экспериментов. Например, разработчик GDB рассказывал, какие улучшения происходят в последних версиях отладчика по просьбам разработчиков LibreOffice. А эти самые разработчики в ответ жаловались, что GDB при отладке их продукта все еще временами подвисает и подтормаживает:) Схожее взаимодействие наблюдается между Eclipse и OpenOffice — во всяком случае, разработчики CDT сделали немало улучшений именно по запросам разработчиком открытого офиса. Что касательно непосредственно офисных пакетов, то мне понравилась презентация использования GPU при работе LibreOffice Calc, а также рассказ про использование групповых политик (GPO) для управления конфигурациями LibreOffice на клиентских машинах. В этом же докладе авторы нахваливали RemoteRoot — новый инструмент для удаленного обслуживания большого парка машин, не требующий (в отличии от того же Katello) наличия специальных агентов на клиентских машинах. Правда, разделы Documentations и Downloads нового инструмента сейчас гордо заявляют «Very soon, please be patient!», так что попробовать это новшество в деле пока не получится.Техническими докладами конференция не ограничивалась. Много слушателей привлекли доклады на юридические темы, рассказы про формирование сообщества и работу с ним и прочие аспекты, немаловажные при создании любого продукта. Было много докладов с научным уклоном — например, про эвристические алгоритмы для решения NP-сложных задач. Целая секция была посвящена инструментам работы с графами — но до туда никто из нас не добрался, так что можем только отослать на сайт FOSDEM за тезисами, видео и презентациями.

В завершение конференции мы побеседовали с представителями Google Summer of Code, в рамках которого сотрудники РОСЫ не раз выступали в роли менторов от Linux Foundation. Обсудили возможность участия в этом году OpenMandriva как менторской организации — представителям OMV тоже такая идея понравилась, так что они попробуют побороться за право участия, и сейчас идет сбор идей для студентов. В конце концов, старая Mandriva участвовала в GSoC, почему бы не попробовать и ее правопреемнице? Конечно, было бы неплохо там поучаствовать и РОСЕ. Но пока объективная реальность такова, что у европейской OpenMandriva шансов существенно больше, чем у российской компании, пусть даже и с международным сообществом. Однако представители РОСЫ вполне могут предложить свои идеи OpenMandriva — ведь у нас много общего в плане кодовой базы, OpenMandriva использует огромное количесвто наработок РОСЫ, так почему бы не поработать совместно над студенческими проектами? На представление идей и подачу заявки от организации есть еще чуть больше недели.

Заодно представителям GSoC был задан вопрос, волнующий студентов из России и ряда близлежащих стран — почему Google в прошлом году перестал присылать в эти страны футболки, ручки и прочие наклейки, ограничившись выплатой стипендий и рассылкой сертификатов. Ведь многие студенты радуются футболкам ничуть не меньше, чем стипендии:) Ответ был таким, что решение было принято на высшем уровне, и точные его причины неизвестны — может, с таможней что-то не так, а может решили упростить логистику. И в этом году улучшений не планируется.

Вот такая вот европейская конференция по свободному ПО. По масштабам российским конференциям до FOSDEM еще расти и расти. Но зато мы гораздо лучше организуем запись докладов:)

Сорри за много букв, но конференция действительно нереально большая, и выше изложено только то, что вспомнилось навскидку, и что я видел своими глазами:)

Перечень всех докладов можно посмотреть здесь, для некоторых докладов можно скачать презентации. Также организаторы обещают в скором будущем подготовить видео большинства выступлений.

|

Теперь можно не боятся бесхвостой мыши в GNOME

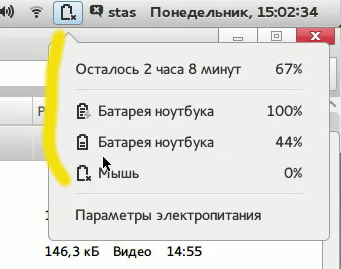

Да-да, именно бесхвостая беспроводная мышь[1] могла пугать пользователей лептопов.

Работаешь, себе работаешь — и вдруг раз, видишь, что аккумулятора осталось на донышке. На самом деле, это была кривая логика рисования иконки заполнения аккумулятора, в случае если подключены другие батарейные устройства: т.е. для полностью заряженного ноутбука, к которому подключена разряженная мышь, не всегда, но часто показывалась иконка разряженного аккумулятора.

Разумеется починили.

На самом деле, таких доработок масса, и практически по каждому нашему коммиту можно писать интересную историю, что мы и проделали по нескольким разнородным доработкам — ведь обидно, что замечают обычно отдельно разработанные продукты, а зачастую тяжелые доработки оторвавшегося в будущее апстрима, остаются незамеченными.

Поэтому сегодня расширим классический наш опрос, добавив пункт, стоит ли нам завязывать с рассказами про подобные доработки.

|

- ↑ А также и беспроводные клавиатуры и прочие устройства ввода с собственными батарейками

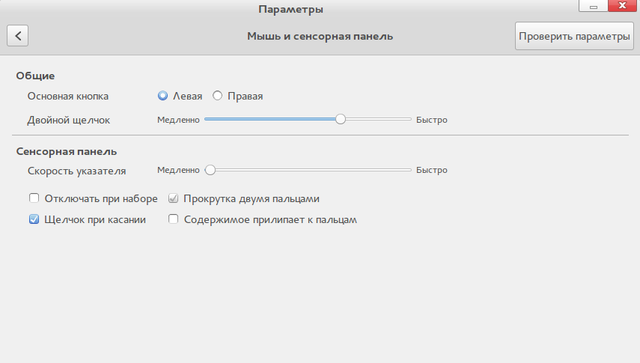

Раскол Магического Коврика — гладить его двуперстно или по краю? Еще одна гномопроблема решена

Да, на самом деле, речь пойдет о настройках тачпада в GNOME, а именно, как обеспечивать скроллирование — по старому обряду, касаясь тачпада по краю, или двуперстно?

Ведь удобный скроллинг — фантастически удобный элемент интерфейса, и изобретение колеса мыши принесло человечеству пользу сравнимую с изобретением настоящего колеса — возникло и настоящее удобство чтения, компьютерные интерфейсы из мелких форм-окошек, пытающихся перекрывая друг-друга разместится на одном экране, стали превращаться в длинные красивые страницы с прекрасным форматированием и инфографикой, в общем, скроллинг это наше все, жить без него плохо, а с учетом того, что десктопы с мышами вытесняются лептопами с тачпадами, тема работающей прокрутки на тачпаде архиважна даже для самого простого домашнего пользователя, не говоря уже о профессионалах.

Исторически, все тачпады[1] умели скроллить «по-краю», когда пальцем водили по правому краю тачпада. Затем, с планшетами и смартфонами пришла новая мода — многопальцевые жесты, и, в частности, двухпальцевая прокрутка, которую, наряду с вышеупомянутой классическо-старообрядческой прокруткой, поддерживают все современные тачпады.

Да, у нас в команде были споры, какой тип скроллинга сейчас более правильный, и, кстати, сейчас хороший повод об этом спросить:

Какой тип прокрутки на тачпаде вы используете?

|

Этот спор у нас возник, когда обнаружили, что в GNOME по-умолчанию, устанавливается «two finger scrolling». У нас тоже, аргументами моды и трендов, победила модная «двухпальцевая» партия, хотя возможно, результат предложенного голосование еще даст нам, ортодоксам, шанс переиграть.

Но в целом, какая разница, если нормально работают настройки системы и можно за пару секунд все правильно настроить.

Каково же было наше удивление, когда мы, тестируя наш гном на ноутбуках с классическими тачпадами, обнаружили, что скроллинг не работает, и поменять его тип невозможно:

Настройка «прокрутка двумя пальцами» была включена, и заблокирована от изменения. Приехали. Да, конечно, продвинутый пользователь поставит и запустит dconf-editor, залезет в очевидное место org.gnome.settings-daemon.peripherals.touchpad……, но нормальный человек такую магию не осилит и справедливо разозлится — «даже тачпад не работает!».

Расследование подтвердило первое же предположение — да, когда-то изначально по умолчанию был «edge-scrolling», а в диалоге настройки тачпада настройка блокировалась, если тачпад не поддерживал многопальцевость. Затем мода поменялась, по умолчанию сделали двухпальцевый скроллинг, а разработчики — либо все сидят на современных лептопах, либо не переинсталлировали систему… в общем, никто и не заметил, что выплеснули всех пользователей старых лептопов.

Good news, everyone!

Разумеется, наша доблестная UXTeam, починила и это. Теперь по-умолчанию, если тачпад поддерживает многопальцевость, предлагается двухпальцевый скроллинг, если нет — скроллинг по краю, ну и в любом случае, все можно в пару секунд сменить для любого пользователя через корректно работающий диалог параметров.

|

- ↑ Кроме совсем древних еретических Sentinel-ов, которые вообще не умеют скроллить.

Допиливаем Gnome Control Center — теперь контроль при любом разрешении

Продолжим рассказывать о серии наших полезных GNOME-доработок.

Те, кто пользуются GNOME Shell, хорошо помнят окно GNOME Control Center: по-военному построенные ряды иконок, расстояния между ними строго фиксировано по уставу, окну не полагается скроллеров и возможности ресайза.

С точки зрения дизайна, это конечно хорошо — сетки, минимализм, консистентность, но… заданные интервалы между иконками явно подбирались под лаконичные англоязычные подписи, и оказались слишком малы для их русских переводов.

Обрезать переводы было бы отвратительным, и мы, проведя исследование, увеличили интервал между иконками, так, чтобы влезали подписи на именно на русском языке — они самые длинные из всех остальных локализаций.

Потом обнаружили ту же проблему с невлезающими подписями в GNOME Tweak Tool, который мы давно сделали полноценной частью GNOME Control Center. Там было совсем плохо — пользователь не мог сделать разумный выбор в обрезанных списках опций.

Затем, тестируя GNOME Fallback на нетбуках, мы обнаружили, что разработчики Gnome совсем забыли про пользователей этих когда-то популярных лептопиков, с разрешением 1024×600 — тут уже проблема была в вертикальной плоскости, т.к. вертикального скроллинга не было предусмотрено, нижние ряды настроек были просто недоступны. А ведь это epic fail — система с недоступным интерфейсом управления.

Да и касается это не только нетбуков — ведь хотя разрешения дисплеев растут в сторону «ретин» и «4K», полно еще живых и используемых старых лептопов, которые под Linuxом будут жить долго и счастливо, их можно использовать самим, подарить родственникам и знакомым, использовать для технических задач (мониторинг и управление какими-нибудь устройствами) — у меня самого есть десяток старых добрых Thinkpad X61, с IPSным дисплеем 1024×768.

Впрочем, доля пользователей старых лептопов относительно невелика, и всегда уродовать окно скроллером не хотелось бы. Поэтому поправили адаптивно, скроллер возникает только когда разрешение по вертикали меньше требуемого, и, думаю, большая часть пользователей его никогда не увидит. Это даже немного обидно, в духе «наша служба и опасна и трудна, и на первый взгляд как будто не видна, на второй как будто тоже не видна, и на тре», поэтому не удержусь, и приложу скринпруф:

В общем, важно то, что хотя GNOME Shell декларирует одной из своих целей «accessibility for people», мы заморачиваемся на тему «accessibility in all computers», и этот пример показывает еще раз, сколько неожиданно мелких доработок надо сделать в GNOME Shell, чтобы перестать ходить по нему как по минному полю, а быть уверенным, что все в нем работает, и так как надо.

Ведь нас часто спрашивают в рассылках, письмах и форумах, почему у вас GNOME 3.8, когда уже готов 3.10, вы же FRESH и все должно быть абсолютно свежее.

Возможно название линейки дистрибутивов «FRESH» действительно немного сбивает с толку, но мы хотели бы прояснить, что мы не гонимся за абсолютными цифрами, у нас нет такого фетиша, это не олимпийские игры, а цифры версий измеряются не в сантиметрах. Мы стараемся сделать удобную и надежную систему, для домашних и профессиональных пользователей, а не только любителей «свежего линукса». И гонка версий тут самая плохая стратегия. Технически, нам ничего не стоит еженочно пересобирать образы, где все будет самое-самое свежее, но новое — это не значит лучшее, и у нас огромные усилия тратятся на контроль качества и доработки.

Мы внимательно следим за свежими версиями программ и в частности Desktop Environment, смотрели и GNOME 3.10, видели очевидную сырость, огромное количество багов, очень странные юзабилити решения[1] при том, что интересных фич там практически не прибавилось.

В общем, если вам действительно нужно быть на самом острие гномо-прогресса, вам, конечно, стоит использовать Fedora. Если же вы хотите попробовать GNOME, обработанный напильником и шкуркой — попробуйте наш дистрибутив, и возможно вы увидите, что не так страшен GNOME, как его малюют, и получите удовольствие и радость, от того, что все работает и не отвлекает от работы и развлечений. Ведь минималистичный интерфейс GNOME позволяет и быстро переключаться между задачами, и при этом не занимает лишнего места и внимания.

|

- ↑ Одно то, что для переключения WiFi сети требуется лезть в настройки… уже достаточно чтобы не мучать этим наших пользователей

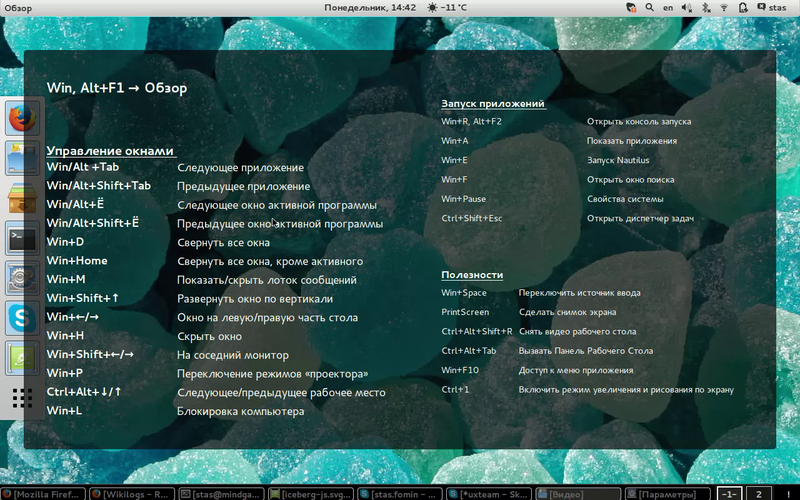

Кнопка WIN ваш лучший друг! Учим горячие клавиши в GNOME

Мы уже говорили про мощь клавиатуры в GNOME, про то, что GNOME SHELL вовсе не «оболочка для планшетов», а наоборот, вполне годен именно для продвинутых пользователей. Там полно удобных хоткеев, а наши доработки позволяют смело пересаживаться продвинутых Windows-пользователей.

Но мы бы хотели, чтобы любой пользователь мог стать Advanced Power User, и смог освоить горячие клавиши — хотя бы постепенно, и по самой комфортной кривой обучения.

Современный пользователь, увы, не будет читать ни справки по горячим клавишам, ни смотреть в хелп, разве что должна быть краткая шпаргалка, которая всегда под рукой… куда бы ее положить?

Ага! Самая важная кнопка в GNOME — это кнопка WIN. Именно эта кнопка включает режим обзора, про эту кнопку рассказывают видеороликом каждому пользователю при первом входе, и именно с ней связаны почти все хоткеи…

И если пользователь, пытается вспомнить, какой там хоткей типа «WIN-чтото-там-еще», он нажимает WIN, и не отпуская, начинает вспоминать… зависает — ага, именно в этот момент самое разумное — показать ему эту шпаргалку.

И показать ее максимально ненавязчиво, в духе шпаргалок GMAIL-а[1], полупрозрачным окном-оверлеем.

Good news everyone!

Мы сделали это[2] — теперь, по долгому нажатию на клавишу WIN, показывается вот такая, аккуратно сверстанная шпаргалка по горячим клавишам:

Единственный хитрый момент — рисование по «CTRL-1», которое обещает шпаргалка, заработает, когда вы включите установленное расширрение «ScreenPen Launch», см. Blog:Точка Росы/Screenpen — магия пера или эффективная свобода преподавания со стилусом.

|

Укрепляем GNOME — дело о пропавшей памяти и неучтенных картинках

Продолжим тему невидимых, но очень полезных доделок и исправлений GNOME.

Ведь на поверхности, что всплывает в разных обзорах — это фичи, внешний вид, обои и иконки, … а реально пользователей в первую очередь беспокоит надежность работы системы, чтобы работало без глюков и торможений месяцами.

Да, месяцами, хотя казалось бы месячный аптайм нужен только серверным системам, пользователям же надо спать и все-такое. Но современный пользовательский подход — работа без перезагрузки, чтобы не терять открытых окон программ, контекстов работы, и десктоп-лептоп не выключается в перерывах, а только засыпает или гибернируется.

Поэтому любые утечки памяти достаточно критичны — ведь стоит оболочке «наесться памяти», система «зароется в своп», все начнет дико тормозить и придется перегружаться, как в давно забытые времена.

Мы серьезно подходим к тестированию клиентских систем, и если говорить о «нагрузочном тестировании» тут, наверное, некорректно, поэтому мы проводим, как мы это называем, «марафонское тестирование» — автоматическое и ручное тестированием системы в течении недель с непрерывным воспроизведением различных сценариев — это и браузер с флеш-видео с ютубом, это и поочередный запуск абсолютно всех установленных программ.

И при этом тестировании мы начали получать неприятные сигналы — тестировщики жаловались, что «этот ваш GNOME ест память, как не в себя». Мы целыми днями мучили gnome-shell Valgrind'ом — но никак не могли найти серьезных зарегистрированных утечек. Однако автоматическое тестирование, запускавшее все пользовательские программы, включая кучу игр, подтвердило сигналы тестировщиков: система в какие-то моменты подъедала память, и часто при тестах, когда система съедала больше четырех гигов, падала тестирующая виртуалка.

Все это выглядело, как будто вроде как добротный сборщик мусора GNOME не спешил отдавать память.

Похожие вещи наблюдались в куче дистрибутивов, гномовцам ставили баги, на которые они писали отписки в духе «это не мы, это ваши графические драйвера виноваты», так что нам пришлось прорываться самим.

Ловили эту проблему несколько итераций, … опустим грустные и неинтересные сложности, расскажем о некоторых выявленных причинах.

Например, внутри Javascript'овой логики (в background.js), создавался внутренний джаваскриптовый кеш-словарь картинок-обоев, причем картинка создавалась для каждого разрешения. В результате, часть программ, особенно которые перехватывали весь экран, как игрушки, в этом кеше происходило накопление картинок.

Теоретически, Garbage Collector от GNOME должен был удалять неиспользуемые картинки, но. Этого не происходило из-за тонкостей биндинга JavaScriptoвой логики с C-шными библиотеками — GC просто не видел, и не учитывал память, занимаемую картинками, учитывая только JavaScriptовые структуры ссылающиеся на них. Да, если бы он освободил их — то освободилась бы и захваченная на «C»-уровне память, но т.к. он эту память не учитывал, то он и не спешил со сборкой мусора и освобождением.

В результате, мы внесли пару точечных патчей именно в JavaScriptовую логику, и эта проблема ушла.

Так что знайте — в нашем дистрибутиве мы не только впиливаем красоту и фичи, но и серьезно исследуем проблемы надежности — к сожалению, там еще есть что копать.

|

Мультизагрузочная флешка с несколькими версиями РОСЫ

Хотите сделать мультизагрузочную флешку с несколькими версиями РОСЫ?

Сергей Жемойтель делится инструкциями по созданию такой флешки с использованием grub4dos на примере 32-битной и 64-битной редакций ROSA Desktop Fresh KDE.

Ниже мы полагаем, что /dev/sdX — это устройство, соответствующее флешке

- Устанавливаем grldr.mbr в корень флешки

dd_rescue grldr.mbr /dev/sdX

- Создаем разделы с помощью fdisk или diskdrake

- /dev/sdX1 — 200 Мб

- /dev/sdX2 — все остальное пространство

- Форматируем разделы

- /dev/sdX1 — ext2 (grub4dos)

- /dev/sdX2 — ext4

- В /dev/sdX1 складываем grldr и menu.lst

- В /dev/sdX2 создаем директории для наших двух образов:

mkdir -p rosa/kde/x86_64 rosa/kde/i586

- Распаковываем образы в директории, соответствующие архитектурами

- Правим наш menu.lst и перегружаемся.

В menu.lst должно быть что-то похожее на это: